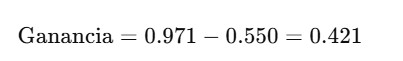

Los árboles de decisión son una de las herramientas más potentes y visuales del análisis de datos. Sirven tanto para clasificar como para predecir, y su principal fortaleza radica en cómo dividen los datos en función de reglas claras y jerárquicas.

Pero cuando nos preguntamos cómo decide el árbol por dónde dividir los datos, entramos en el mundo de los criterios de división, y uno de los más usados es la entropía, tomada de la teoría de la información. En este artículo explico qué es, cómo se calcula, y qué papel juega frente a métodos estadísticos clásicos como los intervalos de confianza o los tests t.

🌱 ¿Qué es un árbol de decisión?

Un árbol de decisión es un modelo que representa decisiones y sus posibles consecuencias, mediante divisiones sucesivas del conjunto de datos.

Cada nodo interno representa una condición sobre una variable (por ejemplo, «¿Edad < 30?»), y cada hoja representa una predicción o clase.

Hay dos grandes tipos:

- Árboles de clasificación: predicen una categoría (ej. «comprará» vs. «no comprará»).

- Árboles de regresión: predicen un valor numérico (ej. ingresos anuales).

🧠 ¿Qué es la entropía?

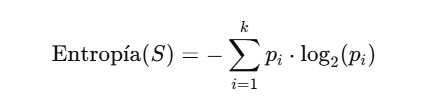

La entropía mide la incertidumbre o impureza de un conjunto de datos. Cuanto más mezcladas estén las clases en un grupo, mayor es su entropía.

donde pi es la proporción de ejemplos de la clase i en el conjunto S.

📊 Ejemplo práctico: ¿Dividimos por edad?

Imagina este pequeño dataset con personas y si compraron un producto:

| Edad | Compró |

|---|---|

| 22 | No |

| 25 | No |

| 28 | Sí |

| 35 | Sí |

| 40 | Sí |

Queremos evaluar si tiene sentido dividir en «Edad < 30» y «Edad ≥ 30».

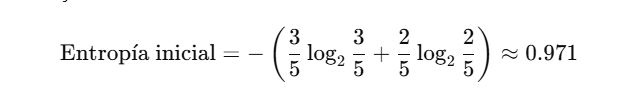

🔢 Paso 1: Entropía total del conjunto

Hay 5 personas:

- 3 «Sí», 2 «No»

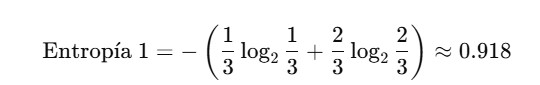

✂️ Paso 2: Dividir por edad < 30

Grupo 1: Edad < 30 (22, 25, 28) → Respuestas: No, No, Sí

- 1 «Sí», 2 «No»

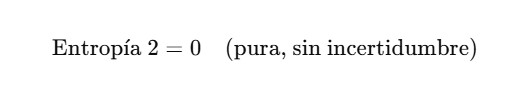

Grupo 2: Edad ≥ 30 (35, 40) → Respuestas: Sí, Sí

- 2 «Sí»

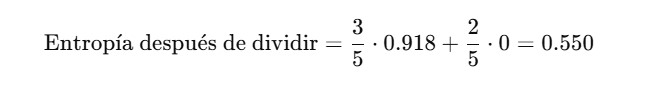

⚖️ Paso 3: Entropía ponderada

📈 Paso 4: Ganancia de información

💡 Conclusión: Dividir por «Edad < 30» reduce bastante la incertidumbre. El árbol considera esta división útil y probablemente la aplicará.

📐 ¿Y qué pasa con los intervalos de confianza?

Mientras la entropía mide la calidad de una división para predecir mejor, los intervalos de confianza o los tests estadísticos responden a una pregunta distinta:

¿Es esta diferencia significativa o podría deberse al azar?

Por ejemplo, podrías usar un test t para saber si la diferencia en la proporción de compras entre los dos grupos es estadísticamente significativa. Incluso podrías aplicar bootstrap para simular muchas muestras y ver si el patrón persiste.

🧩 ¿Se pueden combinar ambos enfoques?

Sí, y cada vez es más común.

Una división puede parecer buena según la entropía, pero si no es estadísticamente significativa, podría no ser fiable.

Combinar criterios informativos (entropía, Gini) con métodos estadísticos (bootstrap, t-tests) mejora la robustez y la interpretabilidad del árbol.

🧠 Conclusión

Los árboles de decisión son intuitivos, pero no mágicos. Comprender cómo y por qué se dividen los datos es clave para usarlos con criterio.

La entropía es una medida poderosa, pero limitada: no considera la incertidumbre del muestreo.

Por eso, acompañarla con herramientas clásicas de inferencia nos lleva a modelos más confiables y explicables.

Deja un comentario